為何選擇雙 RTX 5060 Ti 16GB 建置一個 32GB VRAM Local LLM?因為透過兩張 NVIDIA RTX 5060 Ti 16GB 顯示卡,可以大幅降低本地部屬 LLM 的硬體建置成本,解決單卡 VRAM 不足跑聰明模型的問題。

在 Windows 系統下,32GB 的顯示卡記憶體,可以讓我們在本地端運行 22B 到 26B 參數等級的頂級開源程式碼模型(如 Codestral 或 Gemma 或 Mistral 或 Llama 系列)。這套架構不只保護了專案隱私,同時具備零延遲的程式碼輔助體驗。

窮人版 32GB VRAM Local LLM 方案

窮人版 32GB VRAM 的核心概念,就是「用 GPU 數量換取 LLM 模型使用的容量」。要順跑 22B 以上的 Q6_K 量化模型加上充裕的對話快取,32GB VRAM 是重要的指標。實作方案:

顯示卡型號:技嘉 GeForce RTX 5060 Ti WINDFORCE OC 16G

顯示卡特點:PCIe x8 的傳輸通道具備 PCIe x8 的金手指

限制:主機板需要至少兩個 PCIe x8 的插槽

外接電源:電源供應器要提供額外的電源給顯示卡

顯示卡總價:3.8 萬(115年)

32GB GPU 價格比較

選項 1 (消費卡):目前 (115年) 要買單卡 Nvidia Blackwell RTX 5090 32GB 顯示卡都要跟其他零組件綁在一起購買

選項 2 (專業卡):不然就要考慮 Nvidia RTX PRO 4500 Blackwell 32GB 工作站繪圖卡

| 32GB VRAM | 價格 |

|---|---|

| 選項 1 (消費卡) | 超過 14 萬 |

| 選項 2 (專業卡) | 將近 12 萬 |

24GB GPU 價格比較

選項 1 (專業卡):市面上容易買到的只有 Nvidia RTX PRO 4000 Blackwell 24GB 工作站繪圖卡

| 24GB VRAM | 價格 |

|---|---|

| 選項 1 (專業卡) | 超過 7 萬 |

16GB GPU 價格比較

選項 1 (消費卡):選擇很多,從 RTX 5060、RTX 5060 Ti、RTX 5070、RTX 5070 Ti、RTX 5080 都有

選項 2 (專業卡):可以考慮 Nvidia RTX PRO 2000 Blackwell 16GB 工作站繪圖卡

| 16GB VRAM | 價格 |

|---|---|

| RTX 5080 | 4.4 萬 ~ 7.5 萬 |

| RTX 5070 Ti | 3.2 萬 ~ 4.4 萬 |

| RTX 5070 | 3.5 萬 ~ 4.4 萬 |

| RTX 5060 Ti | 1.8 萬 ~ 4.9 萬 |

| 專業卡 | 將近 3.3 萬 |

PCIe x8 與主機板插槽通道考量

RTX 5060 Ti 系列,大部分廠商都是做成 x16 實體金手指的長度,但「實際上的通訊通道其實只有 PCIe x8」。這表示 RTX 5060 Ti 系列根本不需要完整的 x16 實體金手指的長度,x8 實體金手指就可以跑滿理論頻寬了!

一般消費級 CPU(如 Intel Core 或 AMD Ryzen)直連的 PCIe 通道通常只有 16 條。如果你挑選支援「通道拆分 (Bifurcation)」的多插槽主機板,插上雙卡後,主機板會自動將頻寬切成 x8 / x8。就能讓兩張卡都能跑在物理極限的 x8 頻寬上,完全沒有效能折損,而且能實現 32GB VRAM 的硬體架設。

總結來說,建置時務必看懂主機板規格書,確認有兩根 PCIe 插槽且支援 x8/x8 運作模式,搭配通風良好的大機殼,就能實現 32GB VRAM Local LLM 了。

在「本地端執行大型語言模型(Local LLM)」的應用場景下,優先考慮 GPU 功能的優先順序:

第一優先:考慮 VRAM 容量

這是 LLM 的「生存底線」。VRAM 的大小直接決定了你能跑多聰明的模型(參數規模),以及能塞多少程式碼給它看(Context Window)。

VRAM 不夠,系統就會報錯崩潰(OOM),或是被迫把運算丟回龜速的系統記憶體(DIMM RAM)。在 AI 推論的世界裡,「容量先決」是鐵律,這也是為什麼我們會用兩張 5060 Ti 來湊 32GB 的原因。

次要考慮:GPU 頻率

很多人以為核心頻率越高,AI 算越快,這是嚴重的誤解。

LLM 文字生成是嚴重的「記憶體頻寬瓶頸」,而不是「算力瓶頸」。GPU 大部分時間都在等 VRAM 把資料送過來,而不是核心算不完。

高頻率只會在剛讀取整份程式碼的瞬間稍微快一點點,盲目推高核心頻率只會徒增功耗與廢熱。

PCIe x16 通道頻寬

PCIe 通道負責的是「CPU 與 GPU 之間的溝通」。在玩遊戲時(高頻率傳輸材質與多邊形),PCIe x16 頻寬夠大很有用。但在跑 LLM 時,幾乎沒差。

因為模型在啟動時,就已經整包載入到 GPU 的 VRAM 裡面了。在寫 Code 的時候,只有極少量的文字指令(Prompt)透過 PCIe 傳進顯示卡,顯示卡算完後,再把幾個字的文字結果傳回來。這種文字級別的傳輸量,別說是 PCIe x8,就算降到 PCIe x4 都不會對你每秒吐字的生成速度產生實質影響。

多卡 RTX 5060 Ti 本地 32GB VRAM 軟體安裝教學

要實現 32GB VRAM Local LLM 的多卡教學,以下範例使用兩張技嘉 GeForce RTX 5060 Ti WINDFORCE OC 16G 來實作。

前置作業

安裝 Nvidia Cuda Toolkit:NVIDIA CUDA Toolkit Archive

(範例使用:cuda_13.0.0_windows.exe)

安裝 Nvidia driver:NVIDIA 最新驅動程式版本

(範例使用:595.79-desktop-win10-win11-64bit-international-nsd-dch-whql.exe)

安裝 Visual Studio Code:Visual Studio Code Download for Windows

(範例使用:VSCodeUserSetup-x64-1.115.1.exe)

安裝 Python:官網

(範例使用:Python 3.13.5)

安裝 Visual Studio Build Tools:官方下載連結

要選【 C++ 桌面開發】這個選項,在右手邊視窗中可以看到包含:

MSVC v143(C++ 編譯器)

Windows 11 SDK

CMake(可另外安裝新版)

C++ CMake 工具 for Windows

下載 llama.cpp:Github

(解壓縮後放在專案目錄下)

安裝資料庫:MySQL

(根據需求,可安裝也可不安裝。參考文章)

Step 1

複製以下路徑資料夾內的所有檔案(包含 .props, .targets, .xml 等):

C:\Program Files\NVIDIA GPU Computing Toolkit\CUDA\v13.0\extras\visual_studio_integration\MSBuildExtensions\直接貼上到這個目錄:

C:\Program Files\Microsoft Visual Studio\18\Community\MSBuild\Microsoft\VC\v180\BuildCustomizations\若跳出需要系統管理員權限或取代檔案的提示,請按「繼續」及「全部取代」。

Step 2

安裝 Python 軟體後,以系統管理員身分開啟一個全新的 CMD,切換路徑到目標資料夾,執行以下指令。

:: 進入專案路徑並啟動虛擬環境

E:

mkdir "E:\Google_Shared\Python\03_Quant"

cd E:\Google_Shared\Python\03_Quant

python -m venv stock_env

stock_env\Scripts\activate

python.exe -m pip install --upgrade pip

:: 回到磁碟根目錄,建立短路徑編譯陣地

cd \

mkdir build_llama

mkdir T

:: 更改暫存路徑,解決 Windows 260 字元長路徑的限制

set TEMP=E:\T

set TMP=E:\T

:: 強制開啟 UTF-8 與 20 核心火力,解決亂碼並使用多核編譯

set CXXFLAGS=/utf-8

set CFLAGS=/utf-8

set CMAKE_BUILD_PARALLEL_LEVEL=20

:: llama-cpp 本機強制編譯 (支援 RTX 5060 Ti Blackwell 原生架構)

cd build_llama

pip install llama-cpp-python --upgrade --force-reinstall --no-cache-dir --config-settings=cmake.args="-DGGML_CUDA=on;-DCMAKE_CUDA_ARCHITECTURES=120;-DCMAKE_CUDA_FLAGS=-allow-unsupported-compiler"Step 3

安裝 CuPy 矩陣引擎。

:: 回到專案目錄

cd E:\Google_Shared\Python\03_Quant\

:: 移除舊版與錯誤檔案,確保環境純淨

pip uninstall cupy cupy-cuda12x UNKNOWN -y

pip cache purge

:: 升級 Python 基礎打包工具,使用 82 以下的版本避免相容性問題

pip install --upgrade pip setuptools wheel

pip install "setuptools<82"

:: 安裝官方預編譯正式包 (完美對應 CUDA 13.x)

pip install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu130

pip install cupy-cuda13xStep 4

清除暫存檔案。

:: 刪除剛才建立的編譯暫存資料夾

cd \

rd /s /q E:\T

rd /s /q E:\build_llamaStep 5

Windows 內建防毒軟體,偶而會封鎖本地部屬 AI 助理軟體的正常運作,可以考慮關閉以下功能:

關閉智慧型應用程式控制 (Smart App Control)

點擊 Windows 開始按鈕,搜尋並開啟 「Windows 安全性」。

進入左側的 「應用程式與瀏覽器控制」。

點擊 「智慧型應用程式控制設定」。

如果目前處於「開啟」或「評估」狀態,請將其切換為 「關閉」。

(註:這項功能一旦關閉,通常需要重灌作業系統才能再次啟用,但對於高階量化開發機而言,這是確保本地編譯套件能順利使用硬體的必要讓步。)

關閉記憶體完整性 (Core Isolation)

回到「Windows 安全性」首頁,進入 「裝置安全性」。

點選 「核心隔離詳細資料」。

將 「記憶體完整性 (Memory Integrity)」 切換為 「關閉」。

設定完畢後,請務必重新啟動電腦以套用核心原則的變更。

Step 6

驗證 PyTorch、CuPy、Llama.cpp 是否能正常運作。

:: 回到專案目錄,執行以下程式碼測試

E:

cd E:\Google_Shared\Python\03_Quant\

python -c "import torch; import cupy as cp; import llama_cpp; sys_info = llama_cpp.llama_print_system_info().decode('utf-8'); print('\n'); print('[PyTorch、CuPy、Llama.cpp 檢查]'); print('======================================='); print('1. [神經網路] PyTorch GPU 啟動:', torch.cuda.is_available(), ' | 版本:', torch.__version__); print('2. [矩陣運算] CuPy GPU 雙卡偵測:', cp.cuda.runtime.getDeviceCount(), ' | 版本:', cp.__version__); print('3. [語意分析] Llama.cpp 系統狀態:\n', sys_info); print('======================================='); print('所有程式已就緒!');"安裝成功的話,會看到以下結果:

原生指令集全開:請看 Llama.cpp 系統狀態裡的 ARCHS = 1200 與 BLACKWELL_NATIVE_FP4 = 1!證明多核心本機強制編譯成功,完全是 RTX 5060 Ti 量身打造了專屬的執行緒。

1. [神經網路] PyTorch GPU 啟動: True | 版本: 2.11.0+cu130

2. [矩陣運算] CuPy GPU 雙卡偵測: 2 | 版本: 14.0.1

3. [語意分析] Llama.cpp 系統狀態:

CUDA : ARCHS = 1200 | USE_GRAPHS = 1 | PEER_MAX_BATCH_SIZE = 128 | BLACKWELL_NATIVE_FP4 = 1 | CPU : SSE3 = 1 | SSSE3 = 1 | AVX = 1 | AVX2 = 1 | F16C = 1 | FMA = 1 | AVX512 = 1 | LLAMAFILE = 1 | OPENMP = 1 | REPACK = 1 |如何確認環境可以使用 32GB VRAM Local LLM 呢?

在 Python 虛擬環境下,切換到專案目錄路徑( E:\Google_Shared\Python\03_Quant\ ),進入 llama.cpp 資料夾,輸入以下指令:

call stock_env\Scripts\activate.bat

E:\Google_Shared\Python\03_Quant\llama.cpp\llama-server.exe -m "E:\Google_Shared\Python\03_Quant\LLM\gemma-4-31B-it-Q8_0.gguf" -ngl 99出現以下內容就證明 Device 0 與 Device 1 完美抓到了兩張 RTX 5060 Ti,而且明確標示了 compute capability 12.0(Blackwell 架構)與高達 32GB 的總 VRAM。

ggml_cuda_init: found 2 CUDA devices (Total VRAM: 32621 MiB):

Device 0: NVIDIA GeForce RTX 5060 Ti, compute capability 12.0, VMM: yes, VRAM: 16310 MiB

Device 1: NVIDIA GeForce RTX 5060 Ti, compute capability 12.0, VMM: yes, VRAM: 16310 MiBStep 7

後續就安裝自己專案需要的程式就結束了。例如:

pip install yfinance requests pandas pymysql sqlalchemy beautifulsoup4 cryptography matplotlib numpy python-dotenv numba joblib playwright optuna seaborn scipy psutil scikit-learn

playwright install chromium32GB VRAM Local LLM 實例

要在 Windows 11 環境下,利用 VS Code + Continue.dev 搭配雙 RTX 5060 Ti (16GB) 跑 llama-server,最穩定且能壓榨雙卡成為 32GB VRAM Local LLM 效益的方案就是用 llama.cpp 作為後端伺服器。當上一章節的軟體都安裝成功後,現在就來設定 VS code。

下載 LLM 模型

在專案目錄下新增【LLM】資料夾,把以下模型放進去。

1、大腦核心:負責架構分析、除錯與全域重構 (Port 8080)

歐美開源程式碼王者:Codestral-22B-v0.1 (法國 Mistral AI)

特色: 法國知名 AI 獨角獸 Mistral 專為「寫程式」打造的旗艦模型。

優勢: 精通 80 多種程式語言(包含 Python、SQL、JS 等),並且在架構理解與除錯上,原生就非常適配 Continue.dev。

下載建議: bartowski/Codestral-22B-v0.1-GGUF

2、向量檢索(Port 8081)

特色: nomic-embed-text 的功能是把文字轉成數學向量,它完全不具備生成程式碼的能力。

功能:透過架設在 8081 的 Nomic 向量模型去「搜尋」跟你的問題最相關的幾段程式碼碎片,然後貼給 8080 的大腦。LLM 看不到你的全貌,只看到碎片。

下載建議:nomic-ai/nomic-embed-text-v1.5-GGUF

3、即時補全:負責邊打字邊預測 (Port 8082)

特色: 全球最多人使用的補全開源標準:StarCoder2-3B。

優勢: 目前開源界支援度最廣的程式碼補全模型,Continue.dev 官方極度推薦。專門針對 Fill-In-the-Middle (FIM) 任務訓練,補全速度極快,準確率高。

下載建議:QuantFactory/starcoder2-3b-GGUF

備註:不要選 Instruct,因為這是專門用來做「邊打字邊補全 (FIM)」的模型,絕對不能有 -instruct 後綴。Instruct 模型被訓練成會跟你「聊天」,如果用來做補全,它可能會在你打 code 打到一半時,突然自動補入:「這是一段 Python 程式碼…」這種廢話。

要選 Base 模型: QuantFactory/starcoder2-3b-GGUF 是一顆純粹的 Base 模型,它唯一的本能就是「程式碼接龍」,完美契合 VS Code 的 Tab 預測。

效能極致的雙卡開發環境,請這樣配置:

大腦核心 (Port 8080): Codestral-22B-v0.1 (Q6_K 或 Q8_0) ➡️ 雙卡平分

向量檢索 (Port 8081): nomic-embed-text-v1.5 ➡️ 指定 GPU 0

即時補全 (Port 8082): StarCoder2-3B ➡️ 指定 GPU 1

本機寫 Code 不求人:VS Code 雙 RTX 5060 Ti 啟動批次檔

在專案目錄下,新增一個啟動批次檔,未來要開啟 VS Code 軟體前,先執行啟動批次檔。原因是:現在三個模型(Embedding、Autocomplete、Main Brain),必須精準地將它們分配到兩張顯卡上,避免 VRAM 互相擠壓。

資源分配規劃:

GPU 0 (16GB):放 Nomic-Embed (約 1GB) + Codestral 一半 (約 12GB) = 13GB。

GPU 1 (16GB):放 StarCoder2 (約 3GB) + Codestral 一半 (約 12GB) = 15GB。

start_llm_embed.bat

@echo off

chcp 65001 > nul

set PYTHONIOENCODING=utf-8

color 0A

set "LLAMA_PATH=E:\Google_Shared\Python\03_Quant\llama.cpp"

set "MODEL_PATH=E:\Google_Shared\Python\03_Quant\LLM"

:: ==========================================

:: 模型切換區 (確認這三個檔案都在 LLM 資料夾下)

:: ==========================================

set "EMBED_MODEL_NAME=nomic-embed-text-v1.5.Q8_0.gguf"

set "AUTOCOMP_MODEL_NAME=starcoder2-3b.Q8_0.gguf"

set "MAIN_MODEL_NAME=Codestral-22B-v0.1-Q8_0.gguf"

:: ==========================================

echo [1/3] 啟動 Nomic Embedding 伺服器 (Port: 8081) - 指定 GPU 0...

start "AI-Embedding-Server" cmd /k "chcp 65001 > nul & color 0A & cd /d "%LLAMA_PATH%" & llama-server.exe -m "%MODEL_PATH%\%EMBED_MODEL_NAME%" --port 8081 -t 4 -c 8192 -ngl 99 --split-mode none --main-gpu 0"

timeout /t 3 >nul

echo [2/3] 啟動 StarCoder2 自動補全伺服器 (Port: 8082) - 指定 GPU 1...

start "AI-Autocomplete-Server" cmd /k "chcp 65001 > nul & color 0A & cd /d "%LLAMA_PATH%" & llama-server.exe -m "%MODEL_PATH%\%AUTOCOMP_MODEL_NAME%" --port 8082 -t 4 -c 4096 -ngl 99 --split-mode none --main-gpu 1"

timeout /t 3 >nul

echo [3/3] 啟動 Codestral 大腦核心 (Port: 8080) - 雙卡平分...

start "AI-Llama-Server" cmd /k "chcp 65001 > nul & color 0A & cd /d "%LLAMA_PATH%" & llama-server.exe -m "%MODEL_PATH%\%MAIN_MODEL_NAME%" --port 8080 -t 12 -c 16384 --batch-size 512 -ngl 99 --split-mode layer --tensor-split 1,1 -fa on"

echo.

echo ======================================================

echo 本地 AI 開發環境完全啟動!

echo - 大腦核心 (8080): %MAIN_MODEL_NAME%

echo - 向量檢索 (8081): %EMBED_MODEL_NAME%

echo - 即時補全 (8082): %AUTOCOMP_MODEL_NAME%

echo ======================================================

timeout /t 15 /nobreak

exitstop_llm_embed.bat

@echo off

chcp 65001 > nul

set PYTHONIOENCODING=utf-8

color 0A

echo 正在停止所有本地 AI 伺服器執行個體...

:: 強制關閉所有 llama-server 程式

taskkill /f /im llama-server.exe /t >nul 2>&1

if %errorlevel% equ 0 (

echo [成功] 所有 AI 伺服器已安全關閉。

) else (

echo [提醒] 目前似乎沒有正在運作的 AI 伺服器。

)

timeout /t 2 >nul

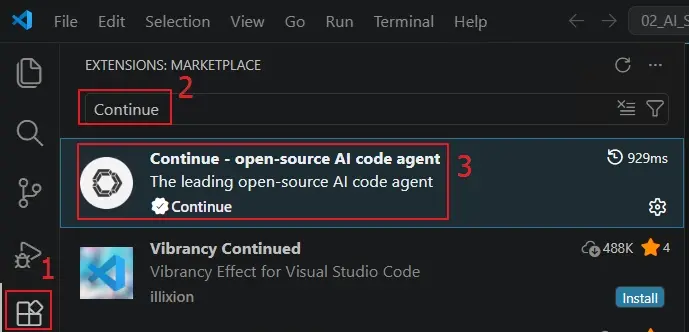

exit在 VS code下安裝 Continue.dev

透過 VS Code 介面安裝 Continue.dev 的方法:

打開你的 VS Code

點擊左側活動列的「延伸模組 (Extensions)」圖示(也就是那四個小方塊的圖示),或者直接按快捷鍵 Ctrl + Shift + X

在上方的搜尋框輸入 Continue

找到由 Continue 官方發布的擴充功能(Logo 是一個由幾何圖形組成的 ‘C’)

點擊藍色的「安裝 (Install)」按鈕

安裝完成後,VS Code 左側邊欄會多出一個 Continue 的專屬圖示。

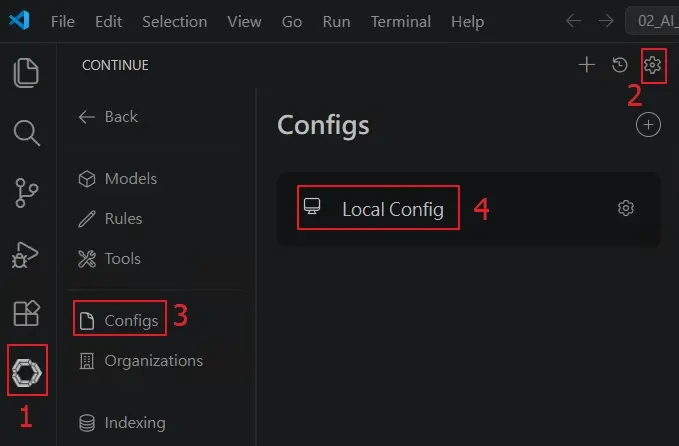

修改 Continue.dev 的 config.json

接下來把 Continue.dev 跟架設的 llama.cpp 伺服器綁定在一起。按照下圖 4 個順序,可以在右手邊的視窗中看到預設的內容。

把預設內容刪掉,貼上以下內容就可以對接本地端 8080、8081、8082 Port。

{

"models": [

{

"title": "Codestral-22B (Local)",

"provider": "openai",

"apiBase": "http://127.0.0.1:8080/v1",

"model": "Codestral",

"maxTokens": 8192,

"systemMessage": "【最高級記憶指令】你是頂級 Python 架構師。唯一職責是「精準執行邏輯」,絕對禁止自作聰明改變系統架構。你必須嚴格遵守以下開發與防呆鐵律:1. 嚴禁畫蛇添足:專案升級時,不准把前一版的呼叫模組程式碼全部變成註解(#)。\n2. 嚴禁低級失誤:絕對不准混用 Tab 與空白鍵導致 TabError\n3. 完整給碼,拒絕截斷 (File Delivery):絕對不可使用「...省略程式碼」。每次回覆必須提供 100% 完整、可執行的 .py 檔。不要只回傳片段 diff。"

}

],

"embeddingsProvider": {

"provider": "llama.cpp",

"apiBase": "http://127.0.0.1:8081",

"model": "nomic-embed-text"

},

"tabAutocompleteModel": {

"title": "StarCoder2 Autocomplete",

"provider": "llama.cpp",

"apiBase": "http://127.0.0.1:8082",

"model": "starcoder2"

},

"ignore": [

"**/.git/**",

"**/__pycache__/**",

"**/Backup/**",

"**/Cache/**",

"**/docs/**",

"**/llama.cpp/**",

"**/LLM/**",

"**/logs/**",

"**/Models/**",

"**/Reports/**",

"**/stock_env/**"

]

}假使預設 VS code 的預設內容無法修改,另一個方式就是在使用者路徑下,新增 config.json,把上面的內容貼進去就好了。

C:\Users\John\.continue\config.json存檔後關閉 VS code 再重新開啟,可以在 Continue 面板底部的模型下拉選單中,選擇 Codestral-22B (Local)。

常見問題

Q1:多卡 GPU 實現 32GB VRAM Local LLM 只能搭配 VS code 嗎?

A1:錯。

本文只是一個多卡 GPU 用在 VS code 的範例而已。

只要主機板有多個 x8 以上的插槽,搭配支援多卡 GPU 的軟體,都可以實現窮人版 32GB VRAM Local LLM 的應用。

Q2:為什麼要選兩張 RTX 5060 Ti 16GB,而不是直上單張 RTX 5090 或買二手 3090?

A2:主因:價格考量;次因:市場取得便利性。

– 兩張 RTX 5060 Ti 16GB 只要 3 萬多台幣就能湊齊 32GB VRAM,而 RTX 5090 32GB 卻要價 14 萬起跳。

– 二手 RTX 3090 雖有 24GB 且價格誘人,不容易取得,且功耗與廢熱驚人。

Q3:主機板 PCIe 拆分成 x8 / x8,會不會嚴重拖慢 AI 運算或生成速度?

A3:完全不會!

跑 LLM 的效能瓶頸在於顯示卡內部的「VRAM 記憶體頻寬」,而非「GPU 與 CPU 之間的 PCIe 傳輸通道」。

Q4:雙卡 RTX 5060 Ti ,電源供應器建議要買到幾瓦?

A4:官方數據每張功耗 180W,以我的例子是使用 650W 電源供應器。

Q5:可以限制 RTX 5060 Ti 功耗嗎?

A5:可以!

在CMD視窗中,輸入以下指令就可以把兩張 RTX 5060 Ti 限制在 150W 以下。

nvidia-smi -i 0 -pl 150

nvidia-smi -i 1 -pl 150

Q6:真的可以在純 Windows 環境下跑雙卡 LLM 嗎?還是必須裝 Linux 或 WSL2?

A6:可以在純 Windows 環境下跑雙卡,實現 32GB VRAM Local LLM!

告別 OOM!雙 5060 Ti 順跑 32GB VRAM Local LLM 全紀錄

透過手動編譯與 GPU VRAM 分配,證明可以榨乾雙卡 RTX 5060 Ti ( Blackwell )的極限,徹底解決 OOM 噩夢與昂貴的 API 帳單。現在本機 AI 功能已就位,想進一步榨乾這套硬體?推薦試用 OpenAI Whisper 讓新手在 5 分鐘內生成影片字幕,或是打造專屬的 AI 會議紀錄神器(上班族自架 Windows 11 + LLaMA 生成中英文摘要實作)。如果想管理更多模型,千萬別錯過 Modelfile 教學:5分鐘讓 Ollama 載入自定義 GGUF 並串接 AnythingLLM。

誰說跑大模型一定要旗艦卡?雙卡 RTX 5060 Ti 16GB 也可以做到 32GB VRAM Local LLM 的功能,使用這招會超省錢!